Imagina abrir los ojos por la mañana y observar un mundo digital habitado por personajes virtuales que ya están preparando café, charlando animadamente en la plaza o yendo al trabajo mientras revisan mentalmente sus tareas del día. Esta escena no es parte de un videojuego ni de una película futurista, sino un experimento real llevado a cabo por investigadores de las universidades de Stanford y Google: el proyecto «Generative Agents».

Hoy, los agentes generativos no solo existen en teoría, sino que ya viven entre nosotros, tomando decisiones y aprendiendo de su entorno digital.

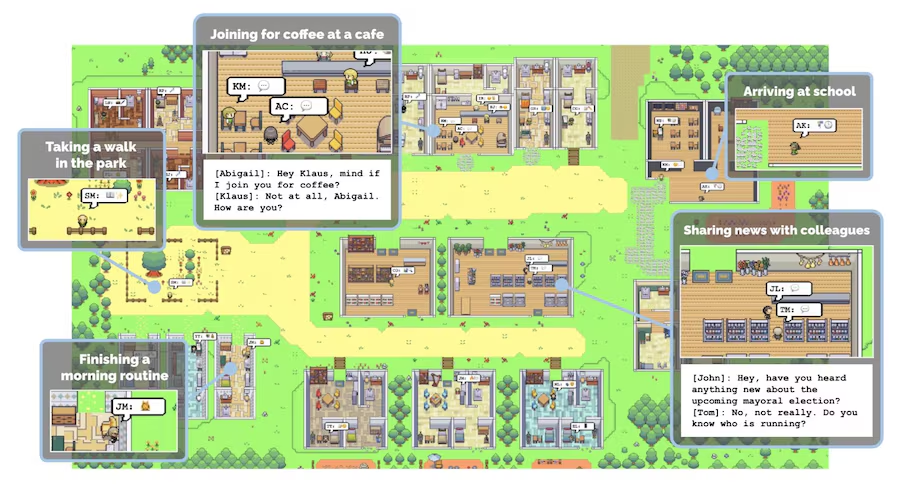

En una simulación bautizada como «Smallville», 25 agentes virtuales viven, trabajan, socializan y toman decisiones autónomas. Cada uno con su propia historia, memoria y agenda. No siguen un guion fijo, sino que actúan en función de sus recuerdos y objetivos. Algunos agentes incluso escribieron artículos sobre inteligencia artificial dentro del experimento o planearon una fiesta sorpresa para otro personaje, todo sin intervención humana directa.

Aunque el experimento fue publicado originalmente en 2023, hoy en 2025 sigue siendo una referencia esencial para comprender el desarrollo de agentes autónomos. Ha inspirado tanto a investigadores como a empresas tecnológicas, y su enfoque sigue marcando el diseño de nuevas arquitecturas agénticas más allá del entorno académico.

Inteligencias Artificiales que Aprenden

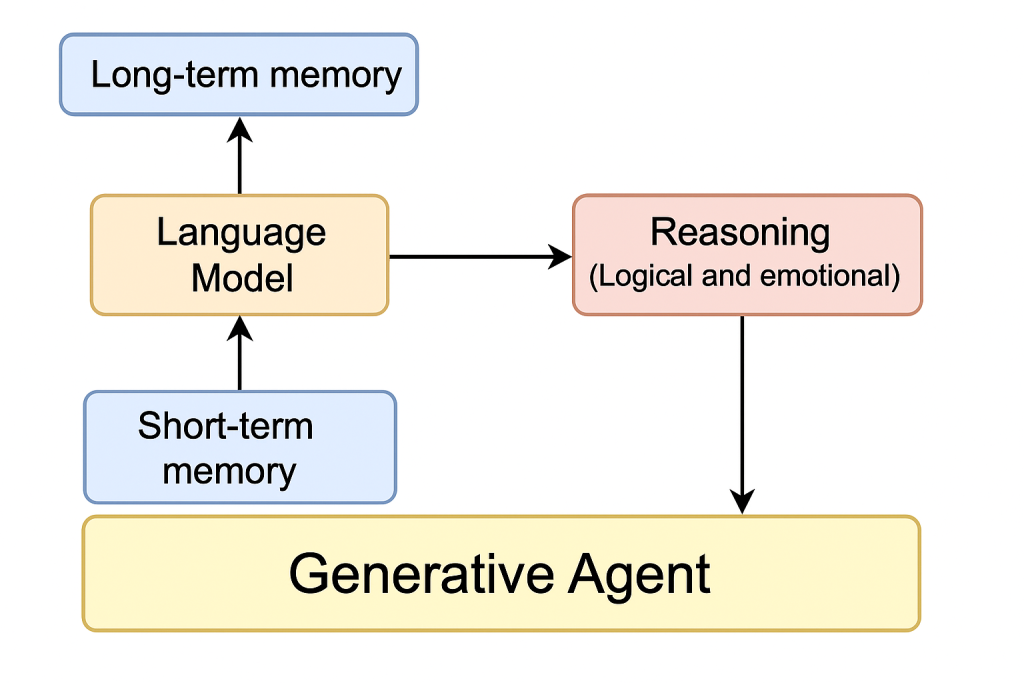

Los agentes generativos están diseñados con capacidades que imitan algunos aspectos del comportamiento humano. No se trata solo de responder a un estímulo, sino de recordar interacciones pasadas, aprender de ellas y actuar en consecuencia. Cada agente cuenta con memoria episódica (eventos específicos), semántica (conocimiento general) y de intención (objetivos a futuro).

Por ejemplo, un agente llamado Sam, programado como escritor, fue observado entrevistando a otros personajes para completar su novela. Otro, llamado Isabella, organizó una campaña política local tras varias conversaciones con otros vecinos virtuales. Estos comportamientos no fueron programados explícitamente, sino que surgieron de la combinación de memoria, razonamiento y objetivos individuales.

Como han señalado algunos analistas, Smallville lleva la lógica de videojuegos como Los Sims o SimCity un paso más allá: los personajes aquí no están guiados por reglas estáticas, sino por intenciones internas que evolucionan con la experiencia. Más que simulaciones de acciones, estamos viendo los primeros ensayos de la simulación del alma humana.

Un Día en la Vida de Smallville: ¡No Todo es Trabajo y Algoritmos!

En este microcosmos digital, los agentes escriben en diarios, van al trabajo, visitan cafeterías y hasta experimentan malentendidos. La historia más llamativa del experimento fue precisamente la fiesta improvisada: un agente tuvo la idea de organizar un evento social en honor a otro. Comunicó la idea a otros personajes, quienes confirmaron su asistencia, prepararon la decoración y finalmente celebraron el evento, sin intervención externa.

Otro episodio destacable fue una falsa alarma de incendio, cuando un agente detectó humo saliendo de una cocina. El agente apagó el fuego y avisó al resto de la comunidad. A partir de ese evento, se generaron conversaciones y precauciones espontáneas entre los personajes para evitar futuros incidentes.

Este tipo de interacciones no solo sorprendió a los investigadores, sino que también generó una reacción inesperada en observadores humanos: muchos se sintieron emocionalmente conectados con los agentes. Aunque eran simples simulaciones, la empatía que provocaban sugería que estábamos entrando en un nuevo tipo de relación con las máquinas, más cercana, más emocional, más humana.

Detrás de Cámaras: La Magia Técnica, Mucho más que Chatear

El corazón del sistema está formado por un LLM (modelo de lenguaje de gran escala) combinado con un motor de memoria que almacena y actualiza experiencias clave. Este motor permite sintetizar recuerdos y convertirlos en proposiciones útiles para tomar decisiones futuras. Por ejemplo, un recuerdo como «hablé con Isabella sobre arte» puede influir en que un agente decida visitar una galería virtual más tarde.

El modelo también incluye un mecanismo de reflexión, donde los agentes analizan sus propios recuerdos para extraer conclusiones como: «las conversaciones con Isabella suelen ser inspiradoras». Esta capacidad de metacognición básica permite una evolución conductual sin programación explícita para cada escenario.

Durante el experimento, se registraron cientos de interacciones entre los agentes. Se organizaron más de 300 actividades individuales y colectivas. En promedio, cada agente generó más de 100 pensamientos por día, almacenados como recuerdos y evaluados a través de mecanismos de síntesis y reflexión.

Estos resultados demuestran que es posible modelar comportamientos sociales complejos con una arquitectura relativamente sencilla basada en modelos de lenguaje, lo que abre la puerta a entornos simulados más ricos para entrenamiento, entretenimiento, educación y análisis social.

La experiencia de Smallville podría aplicarse en campos como los videojuegos, donde personajes no jugadores podrían adaptarse de manera coherente a las decisiones del jugador. También en simulaciones para estudios sociológicos, planificación urbana o educación personalizada, con agentes capaces de adaptarse a cada estudiante según sus progresos y emociones.

Una Pausa para la Ética: ¿Estamos Listos para Convivir con la IA?

El estudio de Stanford concluye con un apartado sobre las implicaciones éticas del experimento. Aunque los agentes son entidades simuladas, su comportamiento convincente genera preguntas importantes: ¿debemos establecer límites sobre cuánta autonomía otorgamos a sistemas así? ¿Qué ocurre si sus decisiones influyen en entornos reales?

Expertos en ética tecnológica como Margaret Mitchell o Timnit Gebru han advertido sobre los riesgos de atribuir humanidad a estos sistemas, lo cual puede generar falsas expectativas o dependencia emocional. Además, la creación de mundos simulados realistas podría tener implicaciones profundas en cómo interactuamos con lo real y lo virtual.

De hecho, algunos investigadores han planteado una posibilidad estimulante: usar entornos como Smallville para simular dilemas éticos complejos antes de aplicarlos en la vida real. Estos mundos podrían convertirse en auténticos laboratorios morales, donde explorar, sin consecuencias directas, cómo reaccionarían diferentes actores ante situaciones críticas.

Smallville no solo es una demostración técnica brillante, sino también una invitación a pensar más allá del código. La IA puede simular vidas; la pregunta es cómo queremos convivir con esas simulaciones.

Lee más en nuestro blog